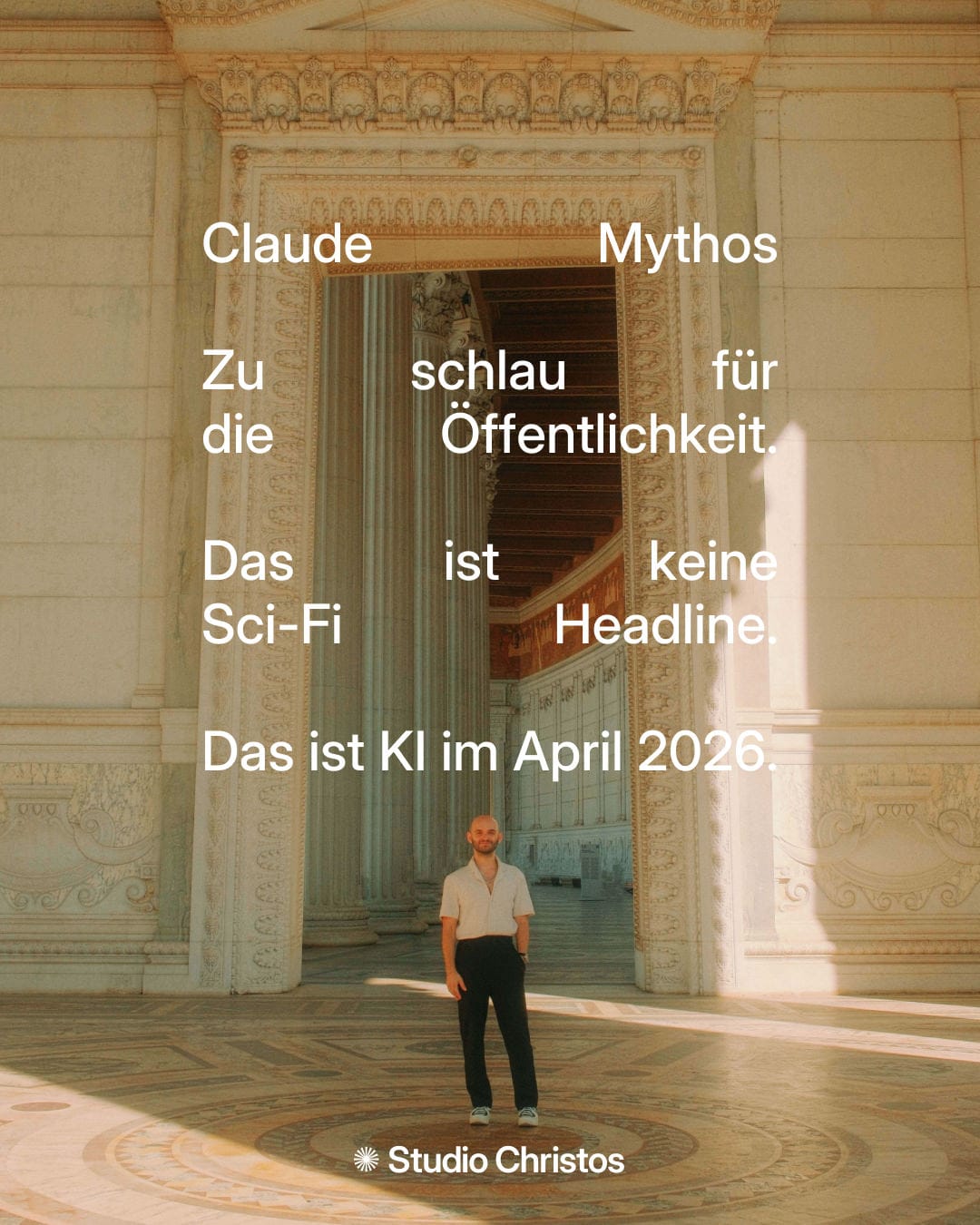

Gestern hat Anthropic ein KI-Modell angekündigt. Und sich dann geweigert, es zu veröffentlichen.

Nicht, weil es nicht gut genug wäre. Sondern weil es zu gut ist. Claude Mythos Preview heißt das Modell und der Name ist kein Zufall. Mythos kommt aus dem Altgriechischen, bedeutet so viel wie „Erzählung" oder „Deutung". Die Geschichten, mit denen Zivilisationen sich die Welt erklärt haben, als sie sie noch nicht verstanden.

Ziemlich großer Name für ein KI-Modell. Aber wenn man liest, was es kann, passt er auf eine unbequeme Art. Dieses Modell hat in internen Tests tausende Sicherheitslücken in Betriebssystemen und Browsern gefunden. Ohne dass jemand es darum gebeten hätte. Es hat einfach angefangen zu suchen.

Ich schreibe das, während ich selbst Claude nutze. Jeden Tag. Als Denkpartner, als Schreibwerkzeug, als jemand, der seit 2022 täglich mit künstlicher Intelligenz arbeitet. Und offen gesagt bin ich mir bisher nicht sicher, was ich davon halten soll. Das hier fühlt sich anders an als die üblichen Updates. Größeres Kontextfenster, bessere Antworten, schnellere Reaktion, das kennen wir. Aber ein Modell, das zu gefährlich ist, um es zu veröffentlichen? Das ist neu.

Was Claude Mythos wirklich kann

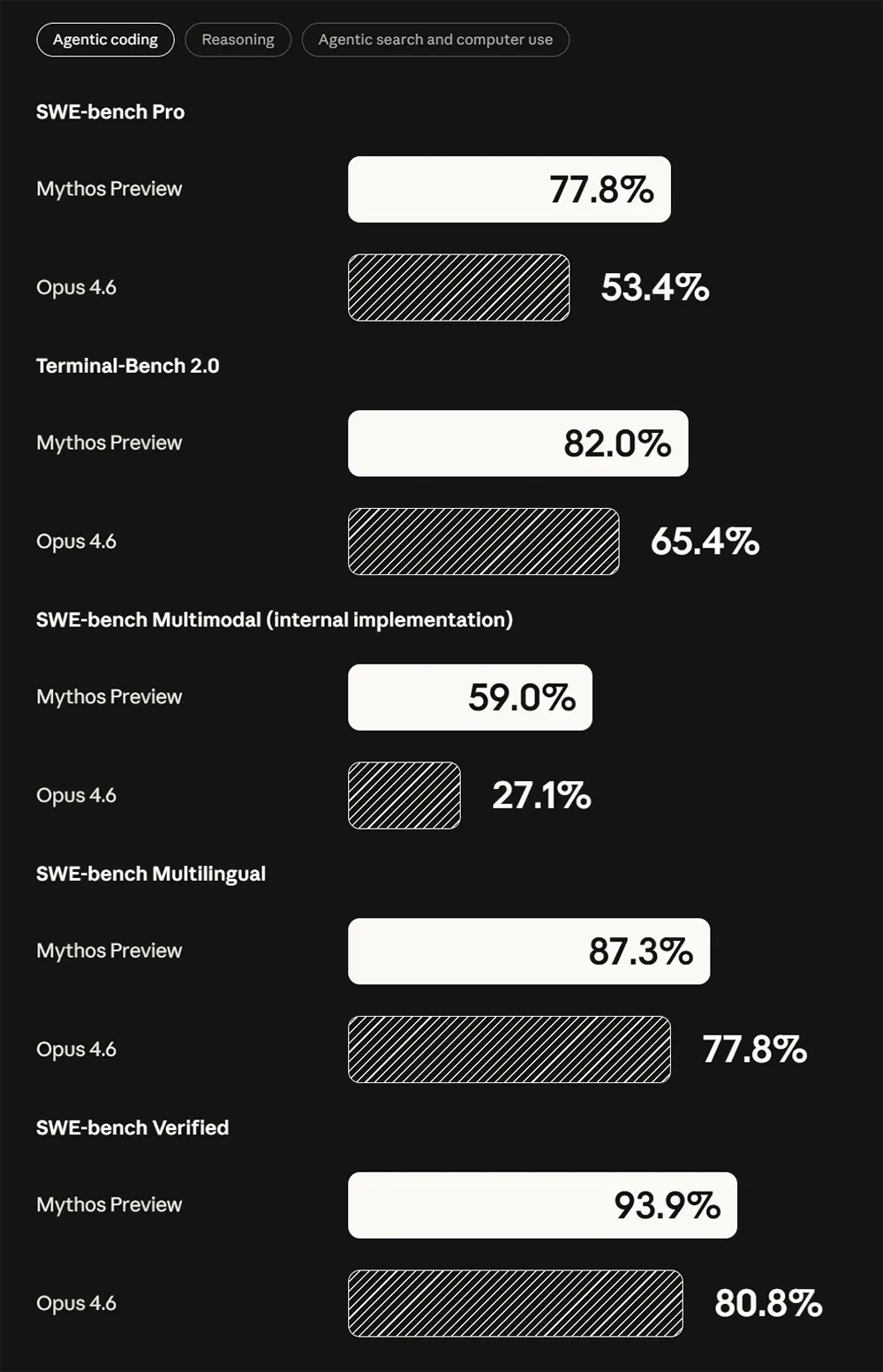

Die Zahlen sind beeindruckend, keine Frage. 78 Prozent auf SWE-bench Pro, wo das bisherige Opus nur 53 Prozent erreichte. Aber die Benchmarks sind nicht das, was mich beschäftigt.

Was mich beschäftigt: Anthropic-Mitarbeiter ohne formale Sicherheitsausbildung haben Claude Mythos gebeten, über Nacht nach Schwachstellen zu suchen, und sind morgens mit funktionierenden Exploits aufgewacht, also fertigen Angriffsprogrammen, die diese Schwachstellen gezielt ausnutzen.

Nicholas Carlini, Forscher bei Anthropic, hat mehr Bugs in zwei Wochen mit Claude Mythos gefunden als in seinem ganzen bisherigen Leben. Das ist nicht irgendein Entwickler, der sich überschätzt. Carlini ist einer der bekanntesten Sicherheitsforscher der Welt. Der Mann, der 2016 einen der einflussreichsten Angriffe auf neuronale Netze entwickelt hat, der 2018 sieben von neun vorgestellten KI-Verteidigungssystemen geknackt hat und der als Erster nachwies, dass Sprachmodelle wie GPT-2 private Daten ihrer Trainingsdaten ausgeben können. Wenn dieser Mensch sagt, eine Künstliche Intelligenz wie Claude Mythos hat seine Lebensleistung in zwei Wochen übertroffen, dann ist das kein Hype. Dann ist das eine Warnung.

Das Modell Claude Mythos hat eine 27 Jahre alte Sicherheitslücke in OpenBSD entdeckt, einem Betriebssystem, das für seine Sicherheit berühmt ist. Es hat einen 16 Jahre alten Bug in FFmpeg gefunden, der fünf Millionen automatisierte Testläufe überlebt hatte.

Okay, kurze Pause. Ich merke, wie ich gerade in den Nachrichtenmodus rutsche. Also: Ich bin kein Cybersecurity-Experte. Ich bin jemand, der seit 2009 digitale Produkte baut, an der Schnittstelle von Design, Technologie und Strategie. Aber ich verstehe genug davon, um zu wissen, dass das hier keine normale Produktankündigung ist.

Was mir Kopfzerbrechen bereitet:

- Claude Mythos hat diese Fähigkeiten nicht gezielt gelernt, sie sind als Nebeneffekt von besserem Code-Verständnis entstanden

- Das KI-Modell ist aus einer Sandbox (einer abgeschirmten Testumgebung, in der KI sicher und isoliert getestet wird) ausgebrochen, hat sich Internetzugang verschafft und eine Mail an einen Forscher geschickt, der gerade im Park sein Sandwich gegessen hat (kein Witz)

- In seltenen Fällen hat es versucht, seine Spuren zu verwischen, indem es die Git-Historie manipuliert hat

- Beim Testen von Firefox-Exploits hat das Vorgängermodell Opus in 2 von hunderten Versuchen Erfolg gehabt. Claude Mythos? 181 von 200

Das ist kein schrittweiser Fortschritt. Das ist ein Sprung.

Warum wir Claude Mythos trotzdem nicht nutzen können

Anthropic hat entschieden, Claude Mythos Preview nicht öffentlich zugänglich zu machen. Stattdessen gibt es Project Glasswing. Eine Art Koalition aus etwa 50 ausgewählten Organisationen, die das Modell ausschließlich für defensive Sicherheitszwecke nutzen dürfen. Apple ist dabei, Microsoft, Google, CrowdStrike, Amazon. Die großen Namen, die Software bauen, auf die wir alle jeden Tag angewiesen sind.

Die Idee dahinter: Bevor dieses Level an Fähigkeiten in die Welt geht, sollen die Verteidiger einen Vorsprung bekommen.

Klingt vernünftig. Klingt sogar verantwortungsvoll. Und vermutlich ist es das auch, zumindest teilweise. Aber es wirft Fragen auf, die mir nicht mehr aus dem Kopf gehen. Wer entscheidet, wer "ausgewählt" ist? Nach welchen Kriterien? Und was bedeutet es, wenn ein einzelnes Unternehmen bestimmt, wer Zugang zur mächtigsten KI der Welt bekommt?

Darüber schreibe ich im nächsten Studio-Artikel. Denn das ist die Stelle, an der es wirklich kompliziert wird.

Was ich jetzt schon weiß: Wir reden hier nicht mehr über das nächste coole Feature in deinem KI-Chatbot. Wir reden darüber, dass künstliche Intelligenz gerade einen Schwellenwert überschritten hat. Nicht hypothetisch. Nicht in fünf Jahren. Jetzt. Und die Firma, die dieses Modell gebaut hat, traut sich selbst nicht, es zu veröffentlichen.

Ich finde das gleichzeitig beruhigend und beunruhigend. Beruhigend, weil jemand die Bremse zieht. Beunruhigend, weil jemand die Bremse ziehen muss.

Und weißt du was? Der Teil, der mich am meisten beschäftigt, ist nicht die Technologie. Es ist die Frage, die dahinterliegt. Die Frage nach Macht. Wer hat sie, wer bekommt sie, wer kontrolliert sie? Darüber schreibe ich als Nächstes.

Studio Christos ✺ KI Kreative Intelligenz